30. November 2021 von Magdalena Stern

Einführung in die Relevanz von KI-Ethik

Künstliche Intelligenz verändert den Blickwinkel. Das ist das Credo unserer adesso-KI-Kampagne und gleichzeitig beinhaltet es einen wichtigen Aspekt, den dieser Beitrag fokussiert. KI wird die Zukunft maßgeblich beeinflussen und wir müssen einen Blick darauf werfen und kritisch durchleuchten, um heute und in Zukunft für die Risiken gewappnet zu sein.

Es geht konkret um die Relevanz der ethischen Aspekte der Künstlichen Intelligenz – kurz KI-Ethik. Und damit sind nicht die Schlagzeilen gemeint, in denen Maschinen die Menschheit zerstören werden, sondern es geht darum, achtsam mit dem Thema umzugehen und ihm einen Raum zu geben. Denn auch wenn diese Zeilen im Internet oder in Buchtiteln überspitzt zu sein scheinen, machen sie trotzdem auf eine mögliche Gefahr aufmerksam, die wir beachten müssen.

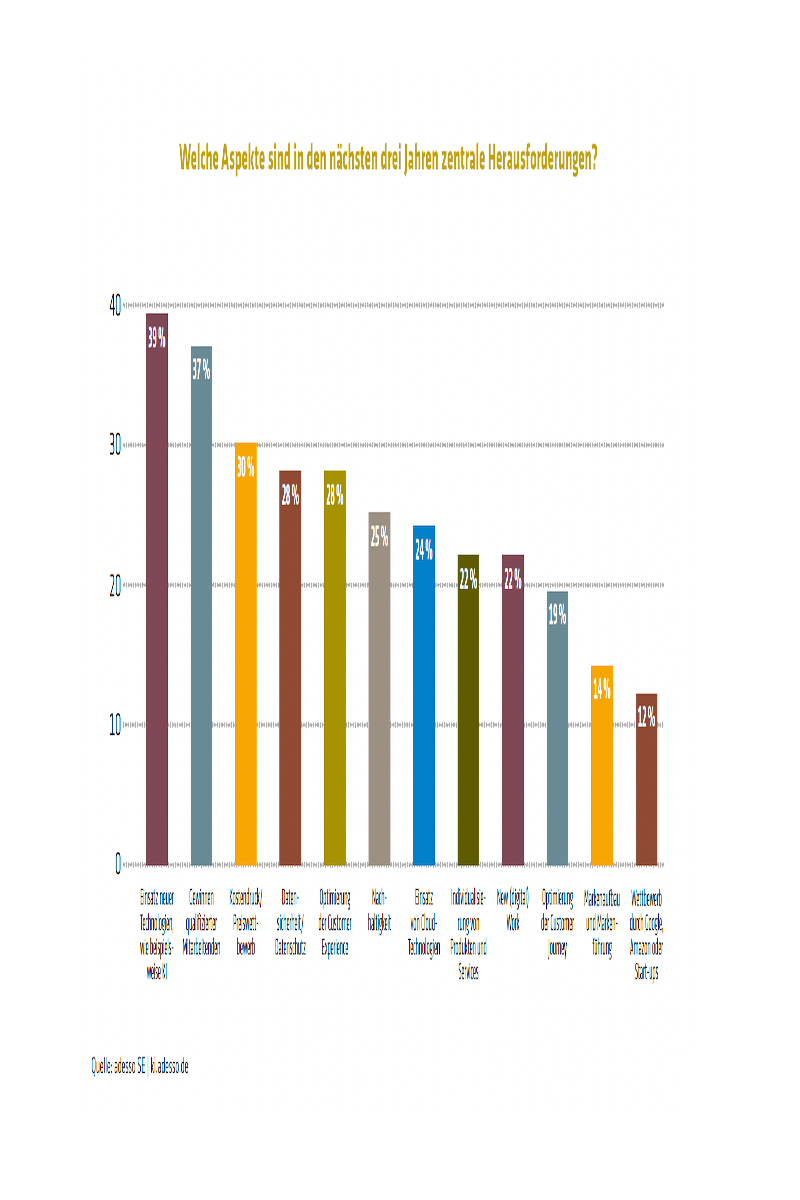

In der adesso-KI-Studie „KI – eine Bestandsaufnahme“ sind 39 % der Entscheiderinnen und Entscheider und somit die Mehrheit der Überzeugung, dass der Einsatz neuer Technologien, wie beispielsweise KI, die zentrale Herausforderung in den nächsten drei Jahren sein wird. Das verdeutlicht die Relevanz von KI und die Notwendigkeit, sich intensiv mit KI-Technologien zu befassen.

Herausforderung – womit befasst sich KI-Ethik?

Um zu verstehen, womit sich KI-Ethik befasst, müssen wir zunächst verstehen, wie KI funktioniert. Ein kleiner Exkurs: Künstliche Intelligenz ist die Fähigkeit einer maschinellen Anwendung, die natürliche Intelligenz nachzuahmen. Das heißt, „Maschinen“ werden in die Lage versetzt, Entscheidungen zu treffen, die dem menschlichen Urteilsvermögen entsprechen – und hier beginnt auch schon der Teil mit der Ethik. Denn der Mensch trifft nicht nur ethisch korrekte Entscheidungen. Der Mensch ist geprägt von verzerrten Wahrnehmungen („Unconscious Bias“), die – ohne dass es uns bewusst ist – Einfluss auf unsere Entscheidungen haben.

Bei Unconscious Bias handelt es sich um kognitive Verzerrungen, die beispielsweise aufgrund von Stereotypen entstehen. Diese meist unbewussten Wahrnehmungsfehler führen dazu, dass wir aufgrund von unvollständigem Wissen bestimmten sozialen Gruppen gewisse (gegebenenfalls falsche) Merkmale, Eigenschaften und Fähigkeiten zuordnen.

Diese Verzerrungen haben Auswirkungen auf die (automatisierten) Entscheidungen, auch algorithmische Bias genannt, die dem maschinellen Lernen (Machine Learning beziehungsweise Deep Learning) zugeordnet sind. Klassisches maschinelles Lernen arbeitet mit Daten und vordefinierten Klassifizierungen. Ein einfaches Beispiel wäre folgendes: Wir haben Äpfel und Birnen und geben der Maschine vor, was die Unterschiede zwischen den Obstsorten sind (zum Beispiel: Äpfel sind rot und Birnen sind grün = Klassifizierung). Wenn die Maschine jetzt neue Daten erhält, kann sie anhand der Klassifizierung zuordnen, ob es sich um einen Apfel oder um eine Birne handelt.

Was aber, wenn es sich nicht um Äpfel und Birnen handelt, sondern um Personen. Und wenn es sich bei der Klassifizierung darum handelt, ob Personen aus einem bestimmten Stadtteil keinen Kredit erhalten, weil es bei anderen Personen aus diesem Stadtteil vermehrt Kreditabbrüche gibt?

Beim Deep Learning findet die Maschine die Klassifizierung selbst heraus. Dazu nutzt sie ein künstliches neuronales Netz aus simulierten Nervenzellen, das anhand einer großen Datenmenge lernt. Ein Beispiel hierzu wäre die Gesichtserkennung aus dem Bereich maschinelles Sehen. Hier sind die Datenmenge und Datenqualität entscheidend. Ein klassisches Beispiel wäre: Nicht genügend farbige Menschen sind in den Bilddatensätzen vorhanden, wodurch farbige Menschen von der Gesichtserkennung schlechter erkannt werden würden als nicht farbige Menschen. Hier hat der Mensch weniger Einfluss, da der Algorithmus „unsupervised“ ist – also nicht durch den Menschen kontrolliert wird.

Für beide Fälle gibt es aber Maßnahmen, um eine korrekte KI-Ethik herzustellen beziehungsweise um die KI ethisch besser entscheiden zu lassen.

In seinem Buch „Human Compatible: AI and the Problem of Control“ gibt der Autor Stuart J. Russell, Professor der Informatik an der University of California in Berkeley, ein passendes Beispiel, wie weitreichend der ethische Aspekt von KI ist. Dabei nennt er die Auswahl- und Empfehlungsalgorithmen in den sozialen Medien: Diese seien nicht besonders intelligent und doch beeinflussen sie Milliarden von Menschen. Ein neuartiges Beispiel sind ebenfalls Deepfakes. Dabei handelt es sich um mediale Inhalte (Videos, Audio-Dateien oder Fotos), die authentisch wirken, aber mit Hilfe von KI beziehungsweise Deep Learning verändert wurden. Diese sind besonders unethisch, da sie den Menschen bewusst manipulieren.

Maßnahmen in Bezug auf KI-Ethik

Es gibt verschiedene Maßnahmen, wie man eine ethische, für sein Unternehmen korrekte KI-Anwendung erstellt. Es fängt an mit den Daten, die für den Machine-Learning-Algorithmus herangezogen werden. Die Daten werden immer in zwei Datensätze (Datasets) unterteilt: Mit dem Trainings-Dataset wird das KI-Modell erstellt, das in der Lage ist, mit dem Algorithmus und neu erhobenen Daten eine (automatisierte) Entscheidung zu treffen. Um bei dem einfachen, oben genannten Beispiel zu bleiben, würde hier die Entscheidung getroffen werden, dass das Obst anhand der Eigenschaft Farbe in einen Apfel oder eine Birne klassifiziert wird. Mit dem Validierungs-Dataset wird dieses KI-Modell nun auf seine „Treffgenauigkeit“ getestet. (Ist bei rotem Obst als Ergebnis wirklich rausgekommen, dass es sich um einen Apfel handelt?) Hier kommt der Mensch beziehungsweise der Data Scientist ins Spiel. Der Data Scientist kontrolliert das Ergebnis und prüft, ob das KI-Modell angepasst werden muss – beispielsweise gab es im Validierungs-Dataset Obst, das keiner der beiden Eigenschaften Rot oder Grün zugeordnet werden konnte.

Hier kann der Data Scientist überlegen, ob weitere Eigenschaften hinzugefügt werden sollen – etwa, ein Apfel ist rund und eine Birne ist oval, um die Treffgenauigkeit beim Ergebnis zu erhöhen. Im KI-Genre wird dieser Prozess Feature Selection beziehungsweise Feature Engineering genannt und gehört indirekt ebenfalls zum Bereich der KI-Ethik. Bei Obst wird es hier keine unethischen Entscheidungen geben, aber wenn wir das Obst wieder in die Kreditwürdigkeit von Person XY umwandeln, dann müssen wir aufpassen, dass zusammengeführte Daten und Eigenschaften den ethischen Normen entsprechen.

Folgende Maßnahmen helfen dem Mitarbeitenden und dem Team bei der Entscheidungsfindung und ermöglichen somit eine verbesserte KI-Ethik:

- Bei der Entwicklung einer KI-Anwendung sollte immer ein gemischtes Team aus unterschiedlichen Geschlechtern, Kulturen etc. zusammengestellt sein, um ein Höchstmaß an verschiedenen Entscheidungsmöglichkeiten zu evaluieren und somit einem Unconscious Bias entgegenzuwirken.

- Es gibt Trainings, wie man mehr auf Unconscious Bias aufmerksam gemacht werden kann. Beispielsweise hat Microsoft solche Trainings standardmäßig im Unternehmen eingeführt und jeder neue Mitarbeitende muss an so einem Training teilnehmen.

- adesso hat eine eigene interne Kampagne – adesso MIND genannt –, die ein achtsameres Miteinander vermittelt. Eine Würdigung und Wertschätzung von Mitmenschen und Arbeitskolleginnen und -kollegen führt zu mehr Akzeptanz und weniger Schubladendenken, also weniger Unconscious Bias.

- Google, Microsoft und auch die Europäische Kommission (als Beispiele) haben für sich KI-Ethik-Prinzipien etabliert und eingeführt (EU: „Ethics guidelines for trustworthy AI“), damit Maßnahmen in Bezug auf KI-Ethik sichergestellt werden. Bei den Prinzipien spielen Datenschutz und -sicherheit ebenfalls eine große Rolle.

- Bei ethisch relevanten Szenarien müssen die Daten immer aus einer Gleichverteilung der Eigenschaften aufgebaut sein, das heißt, es müssen genauso viele Daten mit Eigenschaft X wie mit Eigenschaft Y in dem Dataset verfügbar sein, um keine Benachteiligung entstehen zu lassen.

adesso hat mit der New School of IT noch weitere Maßnahmen definiert und eingeführt, die ich euch im Folgenden näher vorstellen möchte.

adesso’s New School of IT – IT muss neu gedacht werden

Das Konzept der New School of IT hat das Ziel, die Kompetenzen des IT-Betriebs zu verstärken und in die Unternehmensorganisation als Schlüsselposition einzugliedern. So wird sichergestellt, dass Unternehmensprozesse mit der eigenen IT lösungsorientierter, ganzheitlicher und somit auch werteorientierter gestaltet werden können. Damit das funktioniert, sollten Unternehmen ihre Aufmerksamkeit auf folgende drei Handlungsfelder richten:

- Ambidextrous Attitude: ein organisatorischer Ansatz, der einen stabilen IT-Betrieb und visionäre Geschäftsideen durch eine neue Kultur und neue Verantwortlichkeiten miteinander vereint.

- Cloud Native Thinking: Cloud-Computing ist die Basis für Innovationen durch moderne Themen wie Blockchain, IoT und KI. Auf diese Weise sollte das Cloud-Potenzial vollständig ausgeschöpft werden.

- Data Mindedness: Daten sind die Basis für KI und für neue innovative Anwendungen, die Wettbewerbsvorteile sichern. Dabei ist der richtige Umgang mit Daten entscheidend.

Zu den weiteren Elementen von adesso’s Data Mindedness gehören folgende Maßnahmen, die der KI-Ethik zugehörig sind:

- Entwicklung von Datenstrategien für verschiedene Szenarien, um alle relevanten Optionen zu evaluieren und dadurch die Auswirkungen von Bias etc. zu minimieren

- Aufbau einer KI-Strategie, die Datenschutz und KI-Ethik fest integriert

- Aufsetzen einer Produkt-/Service-Roadmap mit Fokus auf Daten und KI

Fazit

KI ist das Geschäftspotenzial der Zukunft und bietet enorme Chancen zur Weiterentwicklung des Unternehmenserfolgs. Mit den vielen aktuellen Neuerungen in Bezug auf die KI-Anwendungsentwicklung, zum Beispiel durch das Low-Code-Prinzip oder die neuen Möglichkeiten in Microsoft Azure, können KI-Anwendungen einfacher erstellt werden und werden somit breiter zugänglich. Geschäftsprozesse werden zunehmend automatisiert und dadurch beschleunigt – unser Blick kann sich also auf die wesentlichen Business Values konzentrieren und somit auch auf die wertebasierten, die der KI-Ethik. Und da müssen wir auch hin, damit nicht nur die quantitativen, sondern auch die qualitativen Werte im Fokus stehen.